Какой дистрибутив операционной системы на базе Linux скачать и установить

Многие из тех, кто перешел на Linux, теперь не хотят возвращаться обратно к операционной системе Windows. Это связано с доступностью этой операционной системы даже для начинающих пользователей. Если вы хотите установить Linux, то необходимо скачать один из многих дистрибутивов, которые написаны на базе ядра Линукс. Приведем примеры лучших из них и расскажем об особенностях системы.

Что такое Линукс и почему так много операционных систем на его базе?

GNU/Linux было разработано как многопользовательское и многозадачное ядро для разных операционных систем. Для которого программисты создали множество графических менеджеров и программных оболочек. От дистрибутива (операционной системы) зависит, для чего вы будете использовать компьютер. Каждая ОС на базе Linux отличается своей функциональной частью. Единой частью всех дистрибутивов является «Терминал», это их основная часть. С его помощью вы можете:

- проводить установку и запуск программ;

- добавлять хранилища для хранения ПО;

- проводить настройку конфигурационных файлов и самого дистрибутива.

Сейчас эта система имеет особую популярность среди программистов, также ее очень часто используют для серверов. Широко распространяться в домашних компьютерах она начала сравнительно недавно, завоевав любовь пользователей за счет широких возможностей настройки: некоторые версии дистрибутивов можно запускать прямо с флеш-накопителя, другие подходят для слабых компьютеров. Дистрибутивы отличаются своим функционалом, размером и внешним видом.

Не все операционные системы на базе Linux можно скачать. Например, Google Chrome OS (да-да, есть и такая операционная система, не только браузер) идет предустановленным на некоторых моделях ноутбуков Samsung, HP и т.п. В открытом доступе официальных дистрибутивов это операционной системы не найти. Зато есть много форков и копий. Мы не будем в этой обзоре давать ссылки на такие сайты. Для каждого дистрибутива в обзоре мы даем ссылку для скачивания на официальный сайт или официальное сообщество.

Почему пользователи отказываются от Windows в пользу Linux?

Чаще всего в качестве достоинств операционных систем на базе Линукс называют:

Отсутствие вирусов. Нельзя сказать, что эту систему вообще невозможно взломать, но хакеры крайне редко проявляют интерес к Linux. Есть несколько рутикулов, которые помогают проникать на сервера, но в домашние ПК они практически не запускаются. О том, что система безопасна говорит и то, что ни у одной антивирусной утилиты нет баз данных специально для Linux. В основном программы настроены на поиск вредоносного кода, который был перенесен с Windows при помощи флешек или дисков.

Практически все дистрибутивы распространяются бесплатно, что позволяет людям с несколькими домашними устройствами не тратить кучу денег на лицензии. При этом вы можете регулярно переустанавливать дистрибутивы, тестировать их и менять. Дополнительное преимущество в том, что программное обеспечение для Linux так же распространяется бесплатно. И приятным бонусом является отсутствие рекламных вставок и сторонних программ, которые загружаются в память ПК вместе с основной утилитой.

Система многообразна и безграничные возможности по настройке внешнего вида. Помимо множества дистрибутивов, вы можете установить на свой ПК разные рабочие окружения. Это поможет вам менять их по необходимости или настроению.

В систему встроен репозиторий. Его идея легла в основу магазина приложений Google Play. Из него вы сможете установить самые разные программы, не прибегая к помощи сайтов и сторонних программ. Единственное неудобство, которое заметно сразу после перехода с Windows, отсутствие привычных названий утилит.

Система удобна по внешнему интерфейсу и разделению программ в меню. Каждая утилита занимает свой раздел в меню, что облегчает ее поиск. Такие небольшие приятные моменты помогают сделать работу намного удобней.

В ядро Linux вшиты практически все необходимые драйвера для периферийного оборудования. Вы можете установить любое устройство, и оно тут же начнет работу. Вам не придется искать драйвера, как для Windows, скачивать их на другом компьютере, чтобы потом оборудование начало работать без сбоев. Неудобств не возникнет даже при подключении новой сетевой карты.

По умолчанию система самостоятельно шифрует диски, что позволяет защитить файлы при попадании компьютера в чужие руки. В Windows подобная опция доступна только при помощи сторонних программ. Этих положительных сторон достаточно, чтобы вы захотели попробовать операционную систему на ядре Linux. Но перед тем как выбирать дистрибутив, стоит ознакомиться с особенностями каждой оболочки и тщательно изучить недостатки ОС.

Недостатки Linux

Для начала приведем ситуации, с которыми так и не смогли справиться программисты, создававшие дистрибутивы Linux. Такие неприятности возникают редко, но для начинающих пользователей они могут оказаться фатальными.

Плохая совместимость с рядом современных устройств. Большинство принтеров, сканеров, роутеров и прочих устройств созданы для Windows. Поэтому они могут работать не всегда корректно. Пользователи могут самостоятельно изменить дистрибутив, чтобы подключенные устройства работали корректно. Если вы не умеете самостоятельно корректировать настройки ОС в том же терминале, то стоит просто скачать и загрузить современную версию дистрибутива.

Некорректная работа графической подсистемы. После выхода из спящего режима, при использовании дискретных видеокарт, может наблюдаться зависание. Избавиться от этой проблемы можно только путем перезагрузки. Проблемы с видеокартами чаще всего появляются после обновления ядра или компонентов, ответственных за вывод графики.

Несмотря на то что многие драйвера вшиты в ядро, они могут переставать устанавливаться автоматически или удаляться после обновления системы. Эта проблема решается откатом на прежнюю версию дистрибутива или установкой новой оболочки.

Некорректная работа системы охлаждения в ноутбуках. Из-за неправильного управления кулеры начинают шуметь или плохо справляются со своей работой. Steam for Linux развивается очень медленно, пользователи не могут скачивать и приобретать любую музыку и приложения. Если вы выберите платную программу, то могут возникнуть проблемы при введении данных карты (не весь пластик принимается магазином). Хотя стоит отметить, что магазин приложений Windows развит не лучше, при его использовании могут возникнуть проблемы. Но в последнем случае есть много альтернативных источников для программ.

Чтобы не сталкиваться с этими проблемами, стоит устанавливать только современные версии операционных систем. Для большинства рядовых пользователей такие неприятности могут стать причиной для отказа от Linux ОС. Хотя стоит отметить, что за последние годы интерфейс оболочек становится все более дружелюбным. Перечисленные выше проблемы разработчики стараются решить, но пока полностью избавиться от них не получается.

Обзор лучших дистрибутивов Linux

Перед тем как установить Linux, стоит ознакомиться с особенностями его дистрибутивов. У каждого из них есть свои плюсы и минусы. А еще помните, что для тестирования ОС не обязательно удалять Windows! Просто используйте виртуальную машину.

Elementary OS

Если для вас важен дизайн операционной системы, то стоит остановить свой выбор на Elementary. Визуально рабочий стол напоминает Mac OS, что позволяет ему выглядеть дорого и красиво. Среди других дистрибутивов, этот вариант выделяется только дизайном и это его недостаток. Хотя именно за это пользователи полюбили Elementary. Это легкая и удобная система, подходящая даже для маломощных машин. По умолчанию в ней не самый большой, но хорошо продуманный набор программ:

- браузер Midori;

- файловый менеджер Pantheon Files;

- медиаплеер Totem;

- почтовый клиент Geary;

- менеджер фотографий Shotwell.

Повседневные пользовательские задач эта система выполняет на 100%. К тому же поддержка фанатов этой ОС привела к тому, что внутри оболочки стали разрабатывать собственные программные продукты. Но при этом у пользователей пока нет возможностей для кастомизации и тонкой настройки оболочки.

Linux Mint

Этот вариант удобен для адаптации пользователей, которые долгое время работали с Windows. Они похожи областью панели задач, системой навигации и рабочим столом. К этой системе выпущено несколько рабочих сред, из которых вы можете выбрать наиболее удобную. Mint представляет собой иной вариант Ubuntu. У него есть несколько преимуществ перед другими дистрибутивами:

- эта сборка достаточно распространена, обладает хорошей поддержкой со стороны пользователей и разработчиков;

- бесплатное распространение;

- несколько рабочих сред легко переключатся при помощи облегченного и удобного графического интерфейса;

- есть несколько встроенных функций: плагины для быстрой загрузки приложений, их запуска и обновления;

- часто обновляется и модифицируется.

Есть два недочета: разрабатывается командой энтузиастов и публичные бюллетени безопасности у этой системы отсутствуют. Эти недостатки не сказываются на работе операционной системы. Отсутствие компании, ответственной за разработку, можно назвать даже преимуществом – создатели системы ближе к рядовым пользователям.

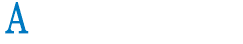

Manjaro Linux

На базе Arch Linux выпущено несколько операционных систем. Одной из них стала Manjaro. Она обладает рядом особенностей:

- простой процесс установки;

- автоматическое обнаружение аппаратного обеспечения;

- обширная настройка рабочего стола;

- стабильность работы;

- возможность установки нескольких ядер;

- специальные сценарии.

Для рабочего стола предлагаются две версии, одна из них используется для продвинутых пользователей. Это быстрая и популярная система с большим количеством пользователей, что позволяет получить хорошую поддержку сообщества. Не опытным пользователям в этой системе будет удобен инструмент для загрузки программ – AUR. Он позволяет обойтись без репозиториев.

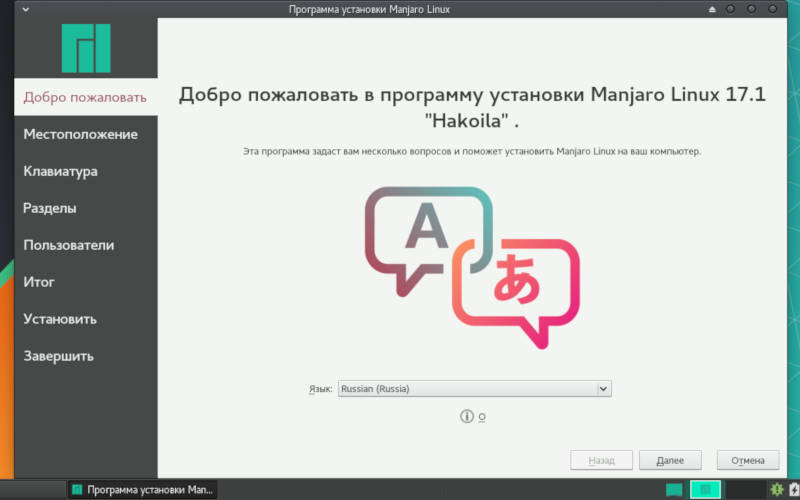

Ubuntu

Этот дистрибутив является самым распространенным и популярным. Практически все пользователи Linux хотя бы раз попробовали его. Система идеально подходит для новичков, которые только хотят ознакомиться с возможностями дистрибутивов. В интерфейсе нет ничего лишнего, в том числе разработчики избавились и от терминала. Для неопытных пользователей может стать недостатком использование командной строки для работы с системой. Преимущества Ubuntu:

- бесплатное распространение, программы и компоненты можно также свободно загружать;

- процесс установки не отнимает более 10 минут;

- в интерфейсе легко разобраться, он понятен;

- без разрешения пользователя в системе ничего не происходит, поэтому риск заражения вирусами минимален;

- можно использовать на одном компьютере с Windows, в систему вшита возможность мультизагрузки;

- в сборку входит достаточный набор программ;

- сообщества и форумы позволяют решить любую пролему.

Основной недостаток этой версии – нестабильность работы. От дистрибутива многие отказываются из-за сбоев, которые сопровождают практически каждое обновление системы. Новые версии часто выдают ошибки, с которыми другие пользователи ранее не сталкивались. После этой версии Linux будет сложно использовать другие дистрибутивы.

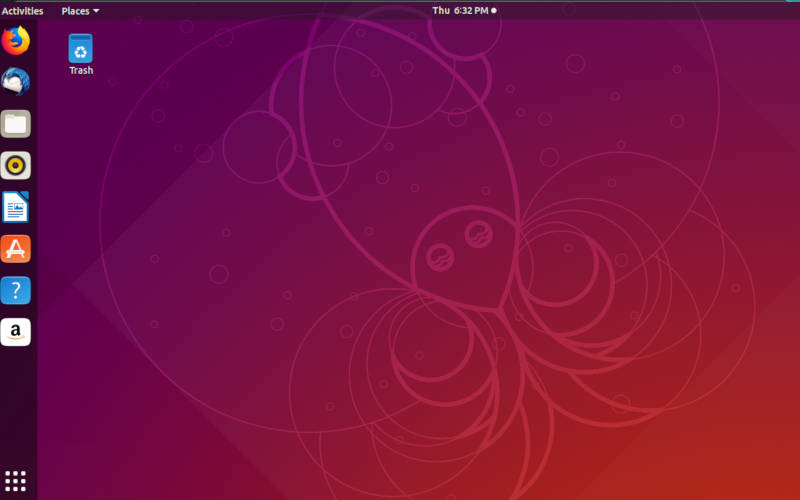

openSUSE

Эта версия чаще всего используется в коммерческих целях. Разработчики раскрыли исходный код своей системы, чтобы программисты со всего мира могли его совершенствовать. Это позволило часто выпускать новые версии. В первую очередь продукт openSUSE интересен для новичков, которые ранее не использовали Linux.

Устанавливать систему можно даже на слабые компьютеры. Ее минимальными требованиями являются: 3 ГБ свободного пространства на жестком диске, процессор Pentium 4 1.6 GHz и всего 1 ГБ оперативной памяти. Управление этой системой сосредоточено в центре YaST. Неопытным пользователям не стоит устанавливать версию Tumbleweed, так как с ней часто возникают проблемы. Лучше всего работать на Leap, обновляемой реже и более стабильной.